Hoy hemos empezado muy bien el día. He llegado al Kinépolis y me ha dado tiempo a tomarme un té y un croisan. Después ha llegado Iván y hemos estado buscando la opción de otro café que nos hemos acabado tomando en uno de los estands.

BSAM: Seguridad en bluetooth

La primera charla, BSAM: Seguridad en bluetooth, la dieron Antonio Vázquez Blanco y Jose Mª Gómez Moreno

|

| RootedCon 2024 - Antonio Vázquez Blanco y Jose Mª Gómez Moreno |

Han descrito ejemplos de dispositivos bluetooth, tanto normales como médicos (marcapasos, bombas insulina...) como básculas y demás dispositivos domésticos. Y pasan desapercibidos a la vez que se deja de lado su seguridad. Y habría que auditorios, pero es complicado. El estándar es complejo de estudiar y no hay muchas auditorías ni herramientas genéricas o la implementación del protocolo es incompleta. La solución es crear una metodología para solucionarlo, y esa es la que han creado: BSAM, solucionando todos los problemas actuales. Entre cada sección fueron poniendo ejemplos. Las fases que contaron están comprendidas en:: búsqueda de información de especificaciones internas (circuitería, chips, implementación capa bluetooth, versión, etc), descubrimiento (con los mensajes de anuncio: que tienen datos necesarios para la conexión como los que no lo son como puede ser un nombre de usuario), emparejamiento (es importante identificar que no se estén usando métodos obsoletos o que no nos puedan robar la clave, que no nos puedan desemparejar un dispositivo...), autenticación ( hay que asegurarse de que la autenticación sea mutua), cifrado (hay que verificar que los tamaños de cifrado sean adecuados y no pequeños), servicios (descubrimientos de qué servicios ofrece el dispositivo porque no debería de haber servicios ocultos que, por ejemplo, tenga permisos rw), aplicación (verificar que las aplicaciones cliente estén bien implementadas, mecanismo de actualización bien implementada). Han mostrado las contribuciones que han hecho en la investigación con wireshark y skapy. Después mostraron una demo

La policía hace cosas

Inmediatamente después, Manuel Fernández nos expuso La policía hace cosas.

|

| RootedCon 2024 - Manuel Fernández |

Policía de los mossos d'esquadra, participó con la guardia civil para investigar un caso de estafa, el caso Forex. La charla tuvo tres partes. 1) qué pasó y cómo empezó la investigación, 2) cómo se coordinaron las distintas FCSE (mossos, guardia civil, etc), jueces, fiscales... Entre otros Europol y Eurojust, con distintos países colaborando juntos. Contó los problemas que tuvieron, pero también los éxitos (como la investigación de las comunicaciones VoIP o el email tracking) 3) Y por último, la coordinación para irse a Albania entre distintos cuerpos de policía europeos para llevar a cabo una operación conjunta. A la hora de identificar qué máquinas requisaban porque había demasiadas para poder investigar sin dedicarle años a recopilar todas las evidencias tiraron de ruby duckers.

Ya en este punto hicimos un pequeño descanso antes de ir a la siguiente ponencia en la sala 17.

¿Quién vigila a los que vigilan?

Borja Adsuara Varela (

@adsuara ) presentó su charla:

¿Quién vigila a los que vigilan?

|

| RootedCon 2024 - Borja Adsuara Varela |

Empieza explicando un meme. Los abogados son como hackers: trabajan con código jurídico y seguridad jurídica. Se detectan vulnerabilidades, como por ejemplo, en el RGPD. Los reglamentos en la UE son de directa aplicación y no debería de hacer falta una transposición a leyes en los estados miembros. Habla de distintos artículos y régimen sancionadores del RGPD. Para hacer el análisis de las leyes se hace un análisis sintáctico de cómo está escrita la ley. Uno de los artículos del RGPD establece que los estados podrán establecer normas para sancionar a administraciones públicas. Uno de los problemas está en que a día de hoy no se puede sancionar a ninguna administración pública. Otro problema está en el Reglamento de IA que se va a aprobar el 13 de marzo. Ha contado el régimen sancionador, mayor al del RGPD, para personas y empresas. Pero también está el mismo epígrafe sobre las administraciones públicas. Una de las conclusiones es que parece que hay una doble vara de medir entre las sanciones de las administraciones públicas y otros porque en lo que respecta a las administraciones públicas en España no tienen consecuencias sancionadoras si se saltan las leyes de protección de datos y aparentemente tampoco las tendrán con respecto a la IA.

La Cartera Europea de Identidad Digital

En la misma sala 17 continuamos con otra ponencia más, La Cartera Europea de Identidad Digital: ¿Garantía de identidad digital o herramienta de control estatal?, por Ignacio Almanillo Domingo ( @ )

|

| RootedCon 2024 - Ignacio Almanillo Domingo |

Habla sobre cómo se ha iniciado en Europa la cartera digital de identidad: EUDI wallet. ¿Hay garantías o es mentira? Hubo dos secciones, la jurídica y la técnica. El tercero que no entra es el problema de los ciudadanos que no estén muy duchos en la tecnología y entreguen más datos de los realmente necesarios. Este reglamento se llama elDAS2. Se busca que haya un nuevo medio de identidad digital, que es un derecho, con control del ciudadano. También se quiere que se tenga una identidad basada en atributos, como podría ser la edad (ej: ser mayor de edad). También puede facilitar abrir cuentas en otros bancos de la UE. Aunque ha explicado algunos problemas de acceso a la sociedad digital. También es importante poderse identificar tanto en local como remotamente. Se puede firmar solo por trocitos o la posibilidad de entregar unos pocos datos sin tener que enviar todo el conjunto entero. Además, tiene ser garante de la privacidad: pseudonominizar la identidad. Se puede poner un mecanismo para que quien quiera acceder a la cartera se tendrá que identificar y que el propietario de la cartera vea quién ha accedido a qué. Después ha hablado de la parte técnica, para que las wallets sean seguras e interoperables entre distintos países. Entre otras cosas también ha hablado de la posibilidad de tener que revocar la app en caso de necesidad.

En cuanto terminó nos fuimos a comer para después volver a la sala 18.

NightClubMare; hackeando dispositivos de DJs

David Cuadrado ha hablado de su herramienta NightClubMare.

|

| RootedCon 2024 - David Cuadrado |

Ha estado describiendo aparatos específicos para DJs, sus características y precios. Después ha explicado distintos términos que usan los DJs. Posteriormente ha descrito las conectividades que tienen estos aparatos: protocolos (UDP), puertos (tanto de protocolo como físicos), direccionamiento IP, ARP, etc, para después hablar de su herramienta, las tripas de la misma y su funcionamiento. A continuación ha mostrado un vídeo a modo de demo que explica el funcionamiento completo. Posteriormente ha contado qué nos haría falta para reproducir lo que ha hecho.

Seguridad en sistemas de videoconferencia

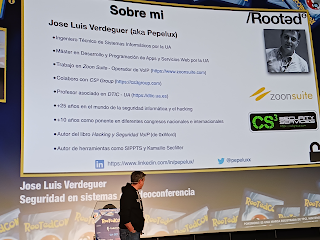

La siguiente charla, en la sala 20, la dio Jose Luis Verdeguer (

@pepeluxx ):

Seguridad en sistemas de videoconferencia.

|

| RootedCon 2024 - Jose Luis Verdeguer |

Las empresas eran reacias a la teleconferencia. Pero después de a pandemia vieron que permiten cancelar las reuniones con mucho menos riesgo que antes, son un ahorro en muchos desplazamientos, etc. Enumeró las distintas soluciones (tanto comerciales como opensource), su historia, etc. Describió el funcionamiento de WebRTC y sus fases: Señalización, conexión, securización y comunicación. Más adelante explicó varios vectores de ataque, tanto con WebRTC como con Zoom. También habló del caso de Telegram en el que se muestra la dirección IP de la otra persona con la que se está haciendo una llamada. Además de recordar la herramienta que ya explicó hace muchísimo tiempo (

SIPPTS), mostró la demo de la herramienta

stuncheck. Aún así, hay datos que muestra la herramienta que también se pueden ver desde el navegador con "webrtc-internals'. A continuación habló de los servidores TURN: permiten hacer redirección a localhost. En cuanto hubo explicado los parámetros hizo una demo. En cuanto la finalizó expuso formas de mitigar el ataque por TCP, pero tampoco se olvidó de UDP, mostrando los problemas que surgen a través de ese protocolo y las posibles mtigaciones.

Ya en este punto de la jornada volvimos a hacer otro descansito.

Dr. Jekill & Mr. Hide

Volviendo a la sala 25, Mark Rivero (

@seifreed ) y Sandra Bardón Moral expusieron

Dr. Jekill & Mr. Hide: las dos caras de un incidente.

|

| RootedCon 2024 - Mark Rivero y Sandra Bardón Moral |

Lo primero que han hecho ha sido darle un disfraz a Román, siendo la broma de la jornada. Después, se han presentado y han empezado a explicar en 10 segundos (contados) el cuento de Dr. Jekill y Mr. Hide. Mark hará la parte racional o de inteligencia y Sandra la parte más "crazy", la parte más ofensiva. Han explicado qué es el grupo Muddywater. Mark ha descrito su procedencia, las herramientas que usan y la victimología, ya que estudian mucho a quién atacar y cómo hacerlo. Son muy adaptativos ya que van cambiando mucho para pasar lo más desapercibidos posibles. Después Sandra ha explicado las herramientas y técnicas utilizadas. Entre otras características, son muy buenos ingenieros sociales. Uno de los C&C que usan es Phony X2, hecho en Python 3. También ha explicado varios ataques realizados en su historia y un resumen del arsenal de herramientas que tiene esa organización. Justo después Mark ha enumerado distintas campañas, ataques y operaciones por ese actor. Ciertas partes de Sandra también se complementaban con las de Mark. Más adelante nos han contado los epic fails que han tenido en ese grupo: acciones que no parece que se correspondan con la experiencia que demuestran como si tuvieran becarios o juniors participando en sus operaciones. Han acabado cerrando con las conclusiones.

MiTM en puntos de recarga de vehículos eléctricos

La última charla, también en la sala 25, la hizo Javier Jarauta Gastelu y Gregorio López con MiTM en puntos de recarga de vehículos eléctricos.

|

| RootedCon 2024 - Javier Jarauta Gastelu y Gregorio López |

Lo primero que han hecho ha sido presentar al equipo que ha participado en la investigación y a ellos mismos. Por lo que he entendido, una de las entidades que ha participado ha sido Cesvimap que les prestó un vehículo para hacer las pruebas. La primera parte ha sido una investigación con IoT poniendo de ejemplo el incidente que hubo hace unos años en los que los dispositivos IoT fueron utilizados para hacer un DoS con el protocolo UDP. Aquí lo que buscan es mejorar la seguridad del tendido eléctrico. El problema está en que dispositivos aparentemente inofensivos para la red eléctrica (como parecía que eran los IoT), podrían tumbarla como por ejemplo una cantidad ingente de aires acondicionados conectados a la vez. Se hicieron simulaciones en las cuales podía haber más o menos éxito según el conocimiento del atacante de la red eléctrica y cómo está construida. Los cargadores son unos elementos que la podrían tumbar si hay muchísimos trabajando a la vez. La pregunta que se hicieron era si es posible controlar la carga de un vehículo eléctrico de forma maliciosa. Ahí explicaron los tipos de carga, según los kW que se estén usando y el tiempo que se esté realizando esa carga. No querían modificar ni el coche ni el cargador, por lo que montaron su propio cable con los conectores para ponerlos entre el coche y el cargador. Explicaron el funcionamiento interno de ese dispositivo en cuanto a potencias y circuiterías. Después mostraron las pruebas de laboratorio. Para el atacante la bentaja de ese cable customizado es que nadie se entera de la manipulación que se ha realizado. Han continuando dando unas conclusiones. No sólo hay riesgo para la red eléctrica, sino también para el vehículo y el punto de carga. Casi acabando han ido contando algún ataque más para verificar los datos de protocolo de red que navegan entre el coche y el cargador. Y hasta ahí pudieron hablar para empezar la hacker night.

Y así con estas ponencias finalizamos la segunda jornada de RootedCon 2024. Que la he disfrutado muchísimo.